Ethical OS Toolkit

Onder het motto 'How not to regret what you built', hebben het Institute for the Future (IFTF) en het Omidyar Network een toolkit ontwikkeld die moet helpen om moeilijk te voorspellen en onwelkome consequenties bij het ontwikkelen van producten en projecten, gebaseerd op AI, te voorkomen.

Wat je wil weten voor je verder leest:

- Voor wie: ontwikkelaars, productmanagers, ingenieurs

- Procesfase: ontwerp

- Systeemonderdeel: datagebruik en -verwerking, de AI-technologie, gehele toepassing, gebruikers, context van AI-systeem

- Prijsindicatie: vrij beschikbaar

Methode

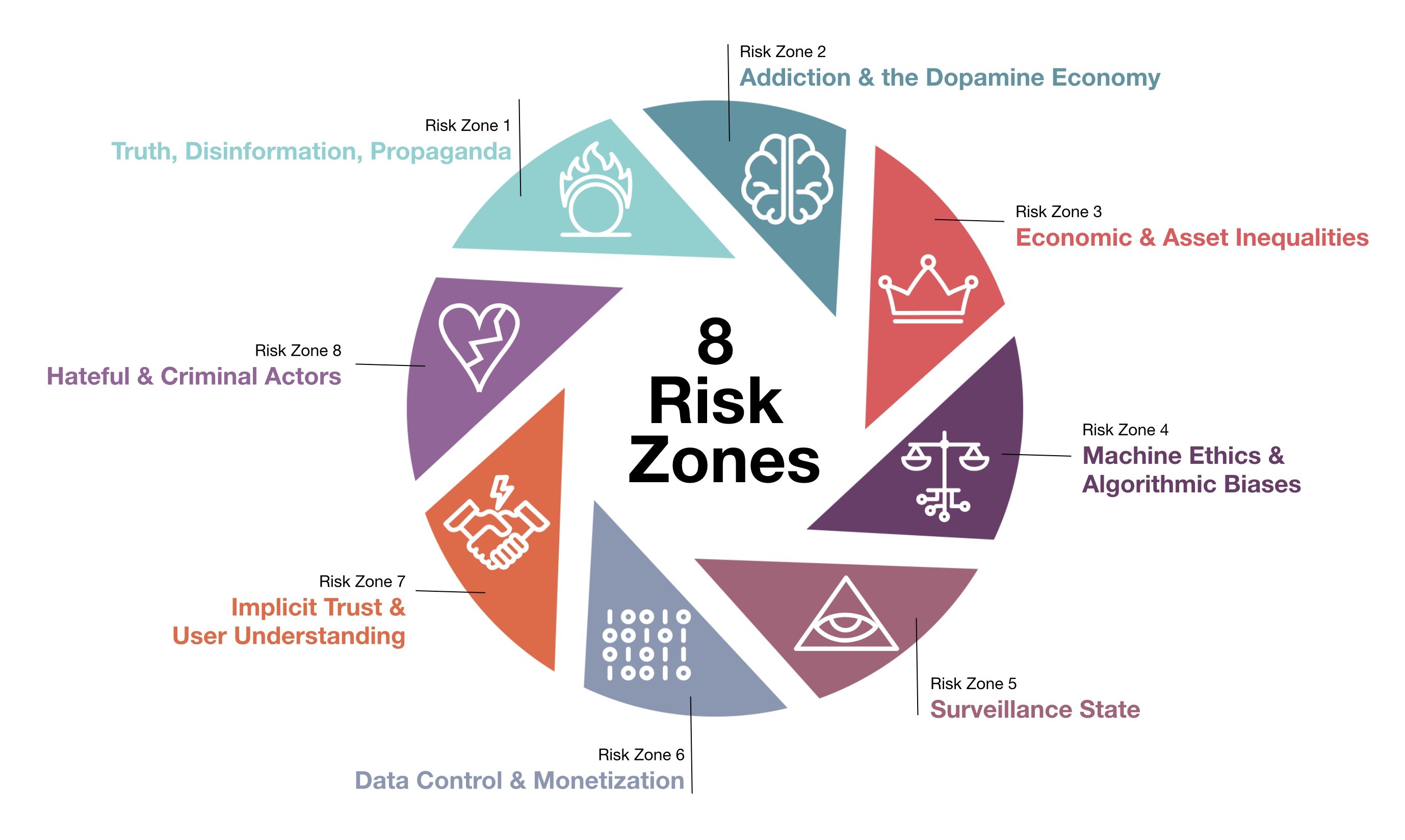

De makers van de toolkit hebben 8 risicozones geïdentificeerd. Naast deze 8 risicozones hebben ze 14 scenario's geschreven die je kunnen helpen met het bespreken van de impact van je AI-toepassing. En verder geven ze 7 strategieën die je bedrijf kunnen helpen om zich voor te bereiden op de AI toekomst.

Resultaat

De toolkit geeft je inzicht in de mogelijke ethische impact van je product. Door de scenario's door te nemen is het mogelijk om ethische vragen ook altijd centraal te houden, dit brengt je een ethische mindset.

| Waarden zoals benoemd in de tool |

Gerelateerde ALTAI-principes |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Link

Deze tool werd niet ontwikkeld door het Kenniscentrum Data & Maatschappij. We beschrijven de tool op onze website omdat die je kan helpen bij het behandelen van ethische, juridische of maatschappelijke aspecten van AI-toepassingen. Het Kenniscentrum is niet verantwoordelijke voor de kwaliteit van de tool.