OECD - OECD Framework for the Classification of AI systems

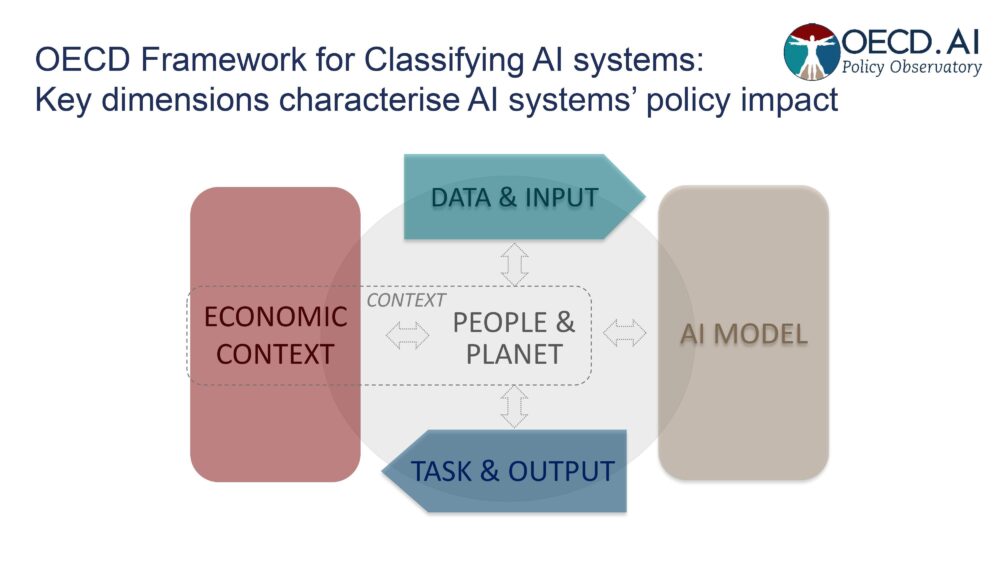

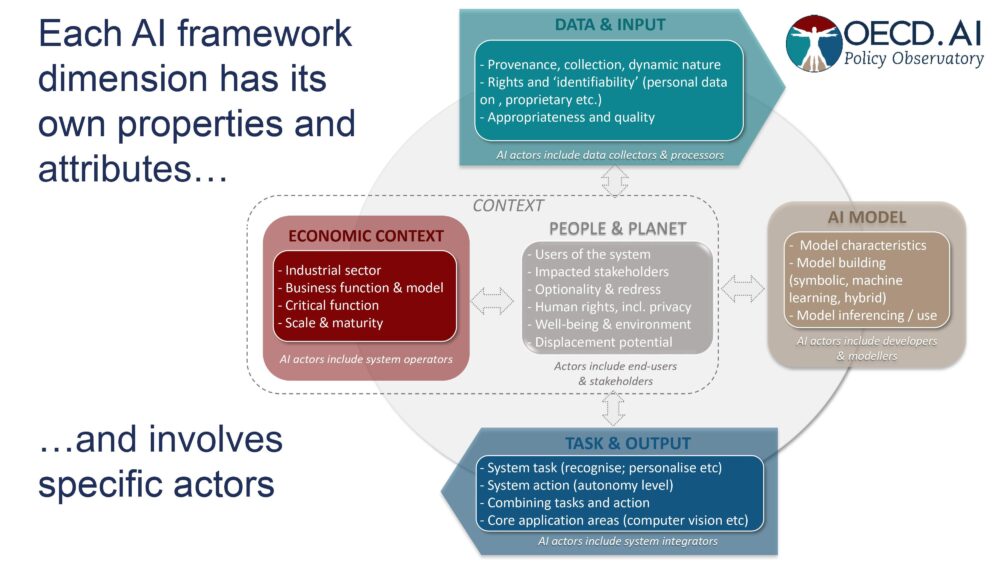

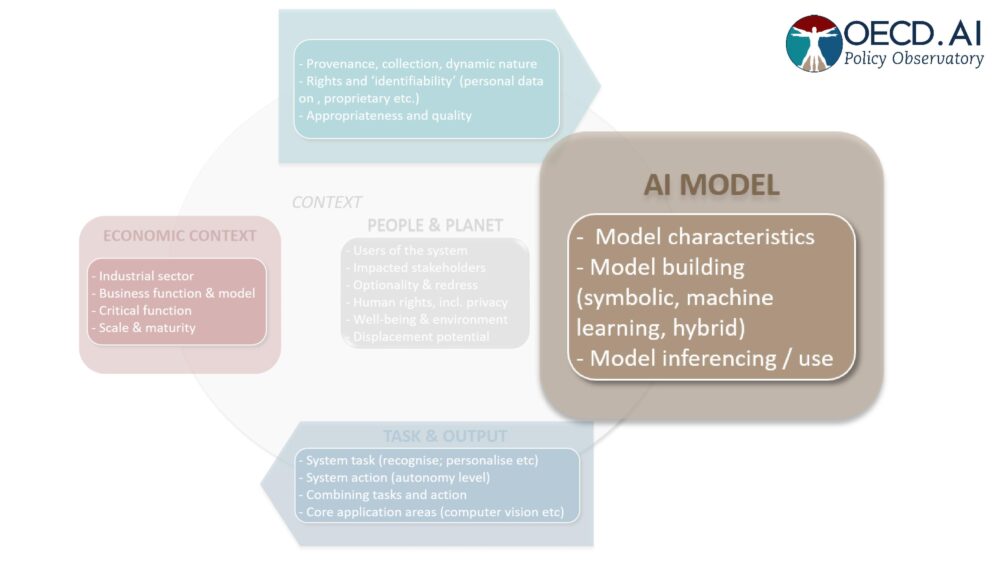

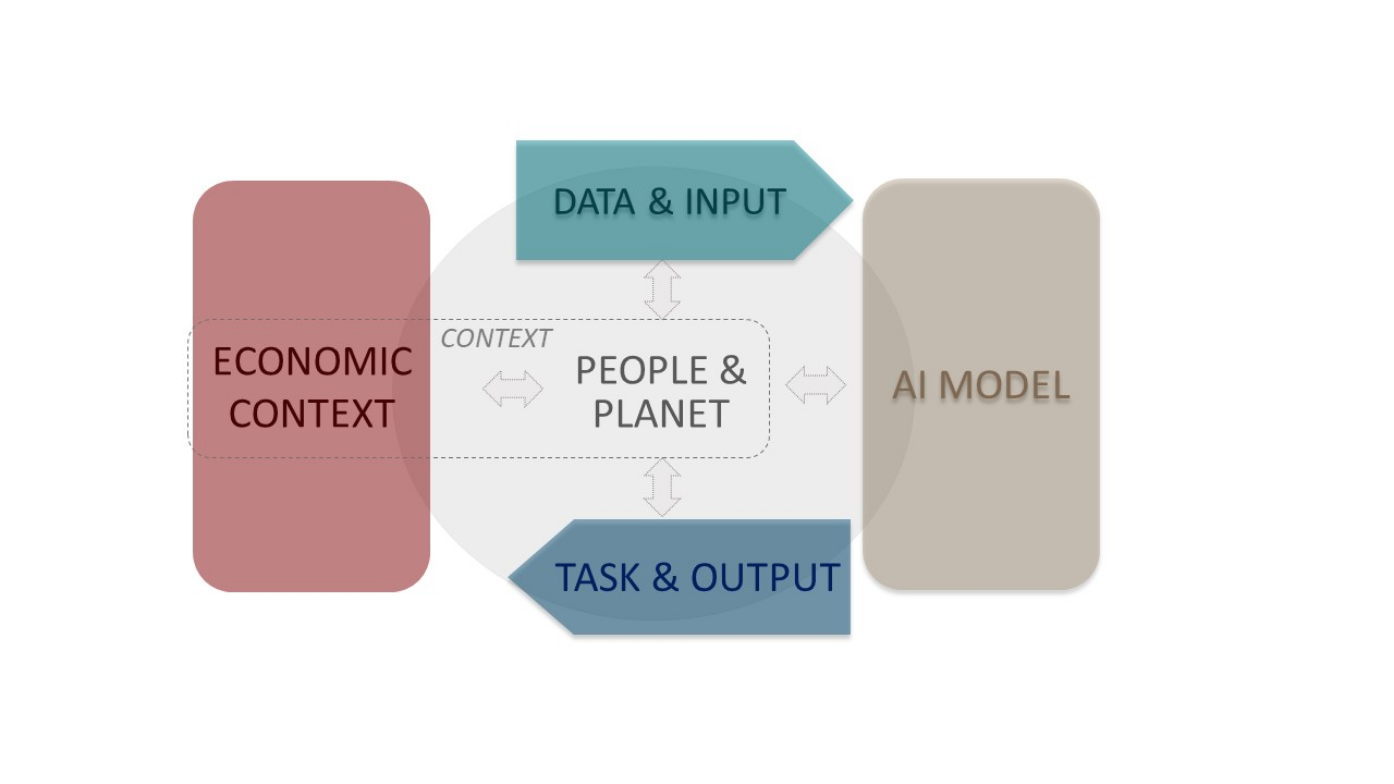

De OESO heeft een classificatieproces voorgesteld om AI-systemen kritisch tegen het licht te houden. Het kader moet beleidsmakers helpen om specifieke risico’s te detecteren die typisch zijn voor AI, zoals bias, verklaarbaarheid (explainability) en soliditeit. Het kader bestaat uit vijf categorieën. Het onderzoekt:

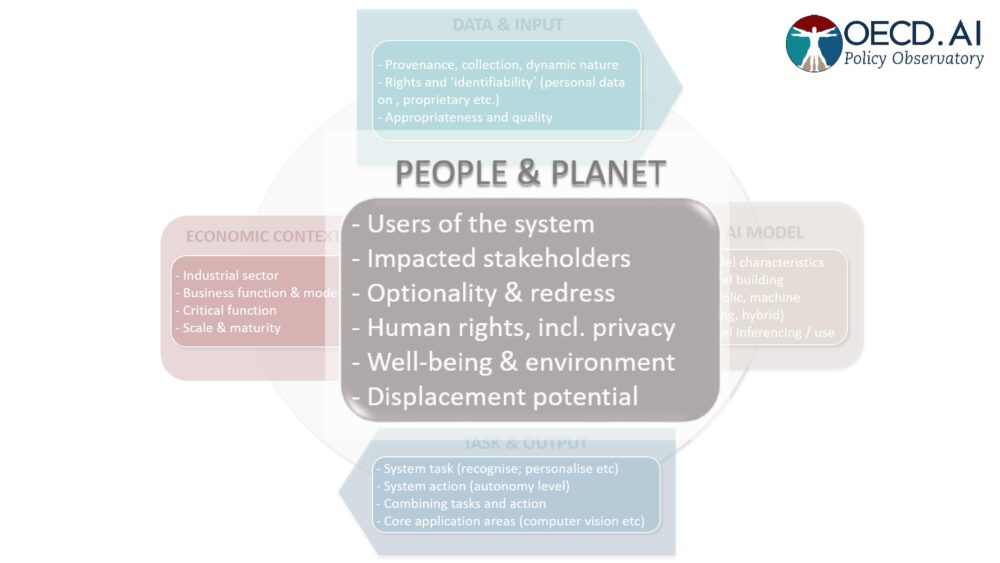

- Hoe AI-systemen mensen en de planeet beïnvloeden

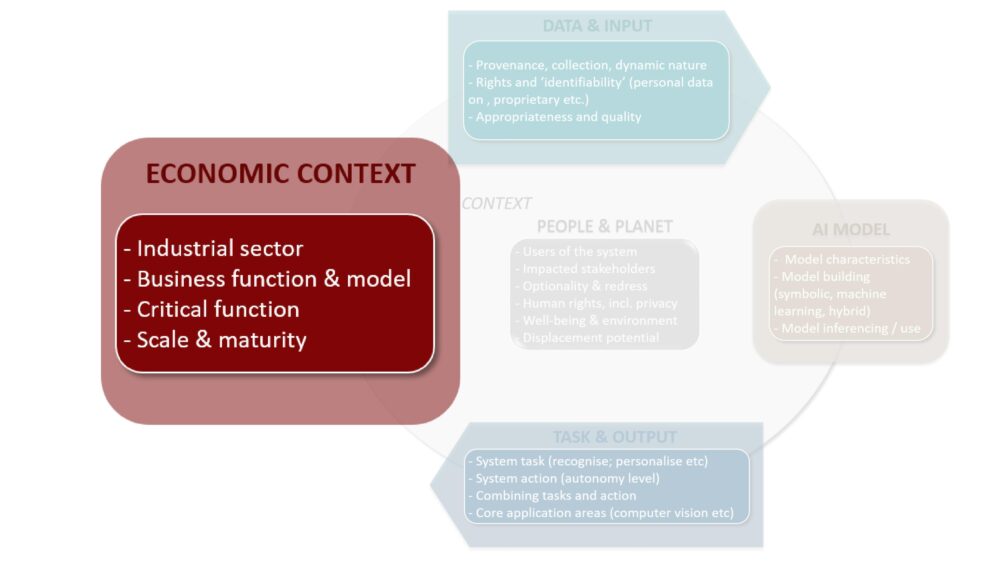

- Hoe AI-systemen de economie beïnvloeden

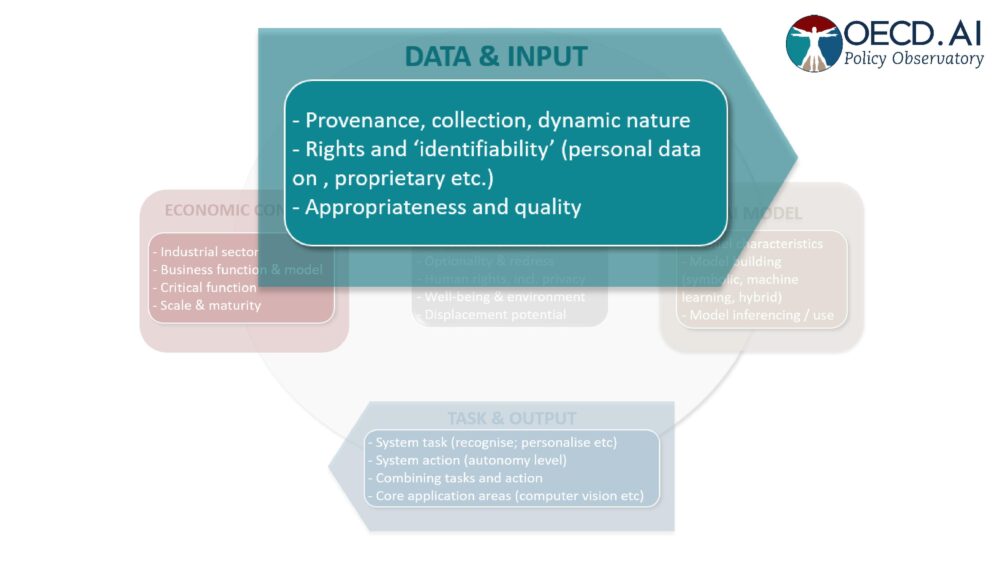

- Welke data werd gebruikt

- Hoe het AI-model functioneert

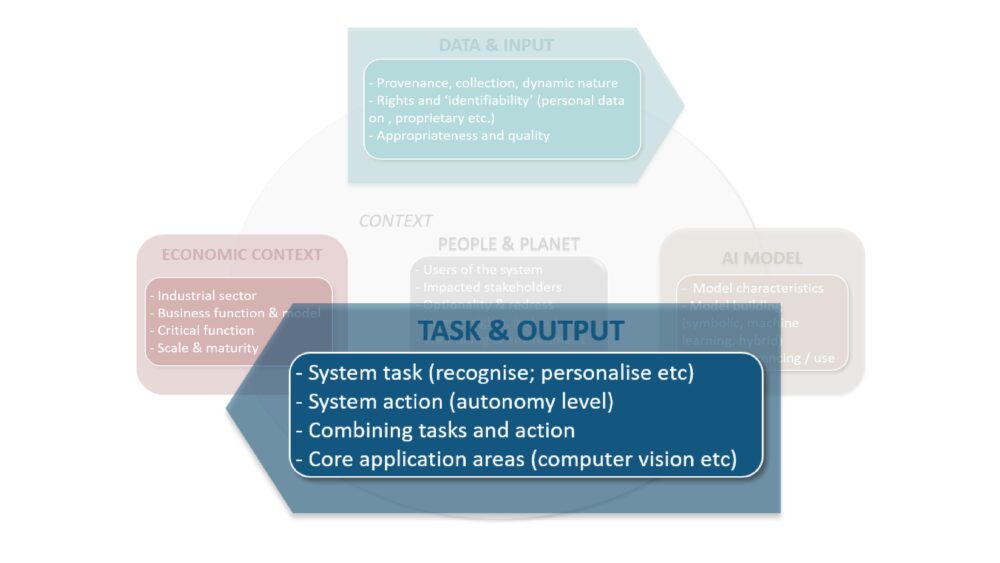

- Welke taken het AI-systeem uitvoert

Via het kader kunnen beleidsmakers makkelijker inschatten wat in de context van AI als riskant kan worden beschouwd.

Wat: Beleidsoriënterend document

Impactscore: 5

Voor wie: overheden, beleidsmakers

URL:

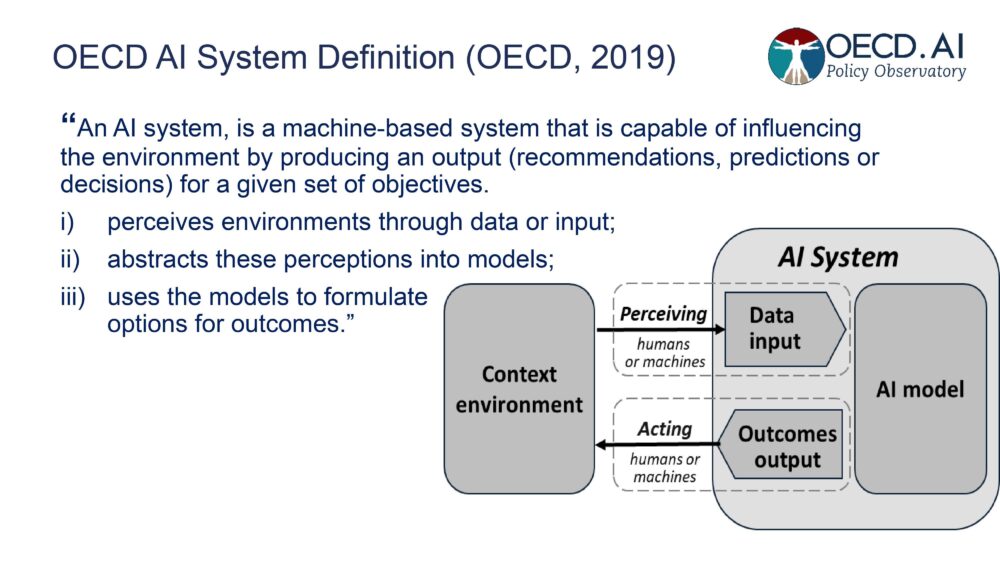

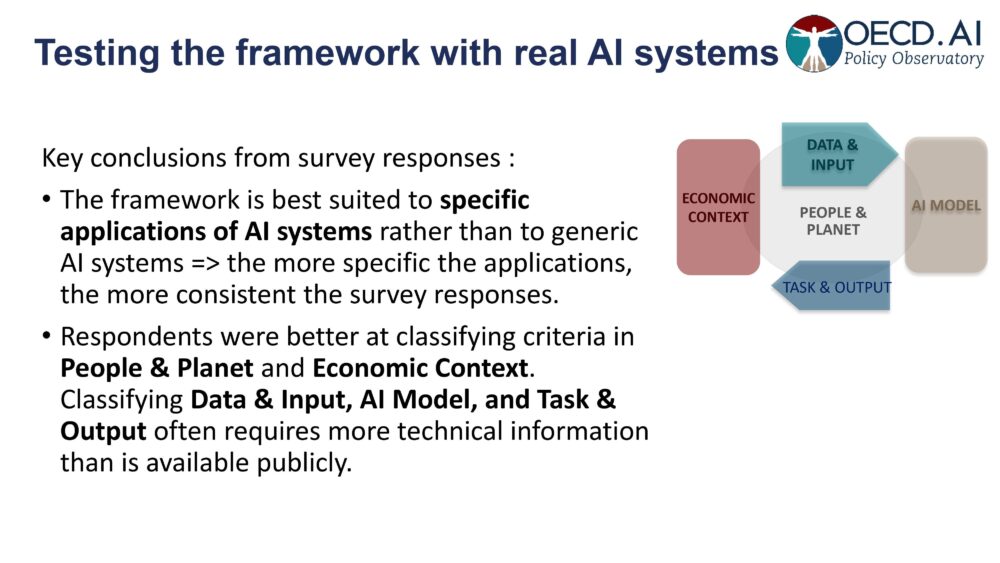

Het kader is een gebruiksvriendelijk instrument om AI-systemen vanuit een beleidsperspectief te evalueren en beleidsmakers en wetgevers te helpen AI-systemen te karakteriseren die in specifieke contexten worden ingezet. Daarbij gaat het niet alleen om waar AI-systemen toe in staat zijn, maar ook om waar en hoe ze dat in de praktijk brengen. Zo kan beeldherkenningstechnologie bijvoorbeeld zeer nuttig zijn voor de beveiliging van smartphones, maar wanneer het in andere situaties wordt gebruikt, kan het een schending van de mensenrechten inhouden.

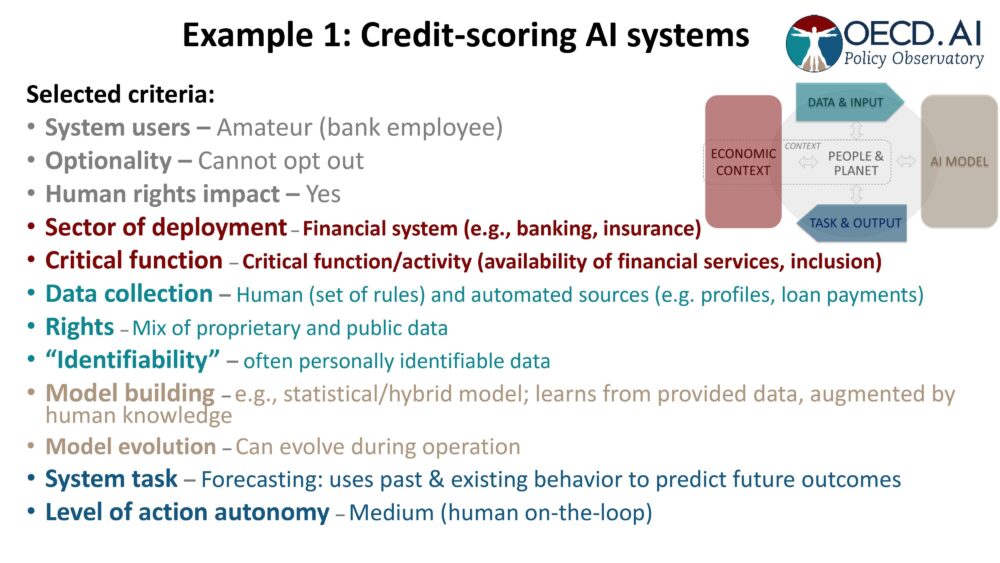

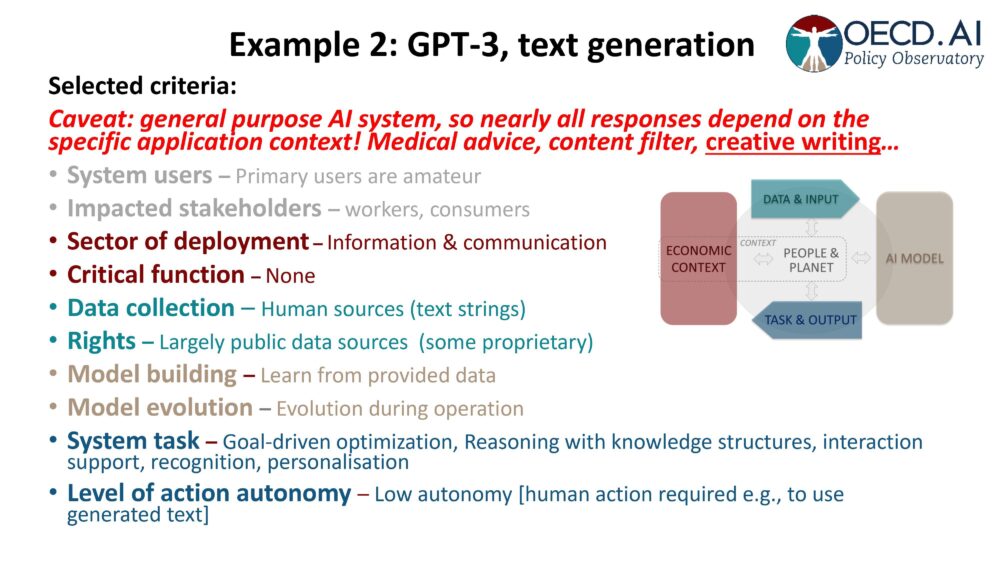

Het OESO-kader bestaat uit vijf categorieën en onderzoekt AI-systemen op basis van hoe ze mensen en de planeet beïnvloeden; de economische context waarin het AI-systeem ingezet wordt; welke data zijn gebruikt; hoe het AI-model functioneert en welke taken het AI-systeem uitvoert. Het raamwerk kan worden gebruikt voor elk AI-systeem, van een GPT-3 taalmodel tot credit-scoring systemen.

Elk van de dimensies van het kader heeft een subset van eigenschappen en kenmerken om beleidsimplicaties te definiëren en te beoordelen en om een innovatieve en betrouwbare benadering van AI-beleidsvorming en -bestuur te helpen sturen, zoals uiteengezet in de AI-beginselen van de OESO.

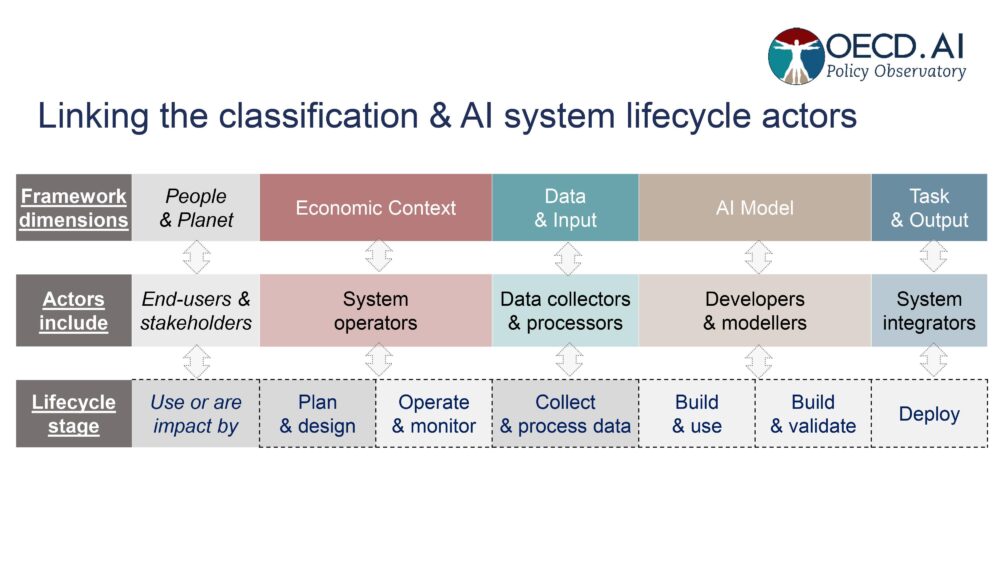

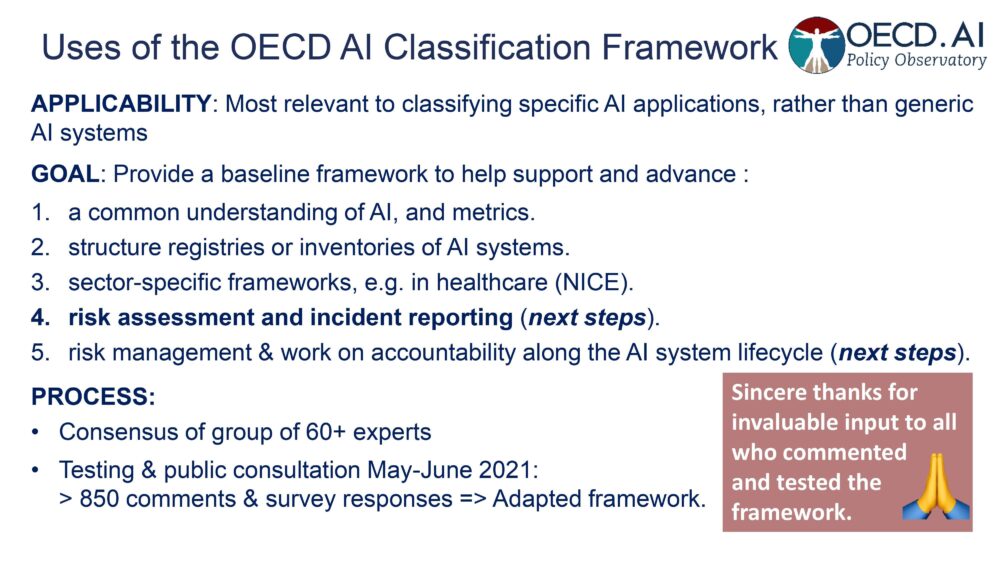

In het bijzonder biedt het kader een basis om:

- Een gemeenschappelijk begrip van AI te bevorderen: kenmerken van AI-systemen te identificeren die er het meest toe doen, om beleidsmakers en anderen te helpen het beleid af te stemmen op specifieke AI-toepassingen en te helpen bij het identificeren of ontwikkelen van meetmethoden om meer subjectieve criteria te beoordelen (zoals de impact op het welzijn).

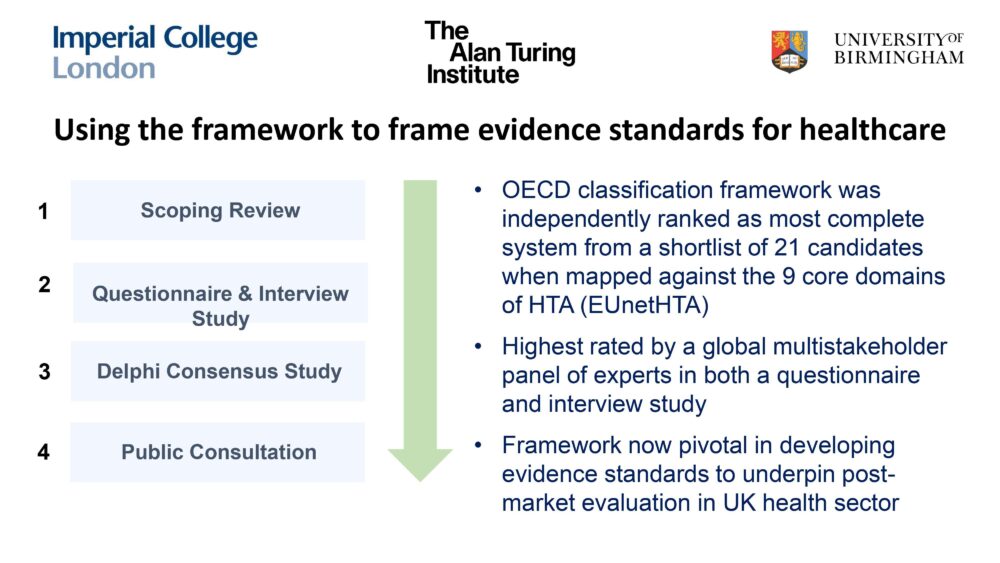

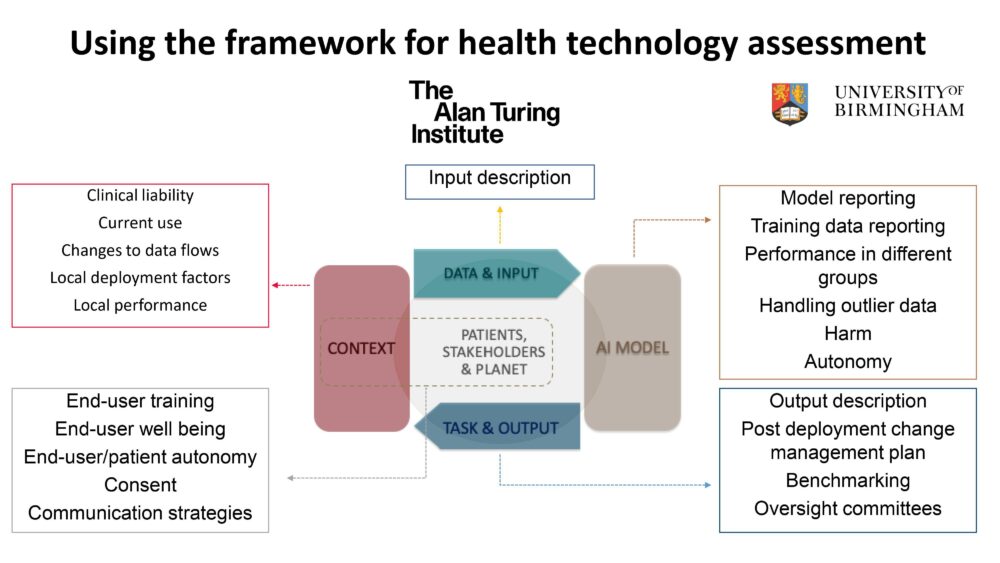

- Ondersteuning van sectorspecifieke kaders: De basis vormen voor meer gedetailleerde toepassings- of domeinspecifieke overzichten van criteria, in sectoren zoals de gezondheidszorg of in de financiële wereld.

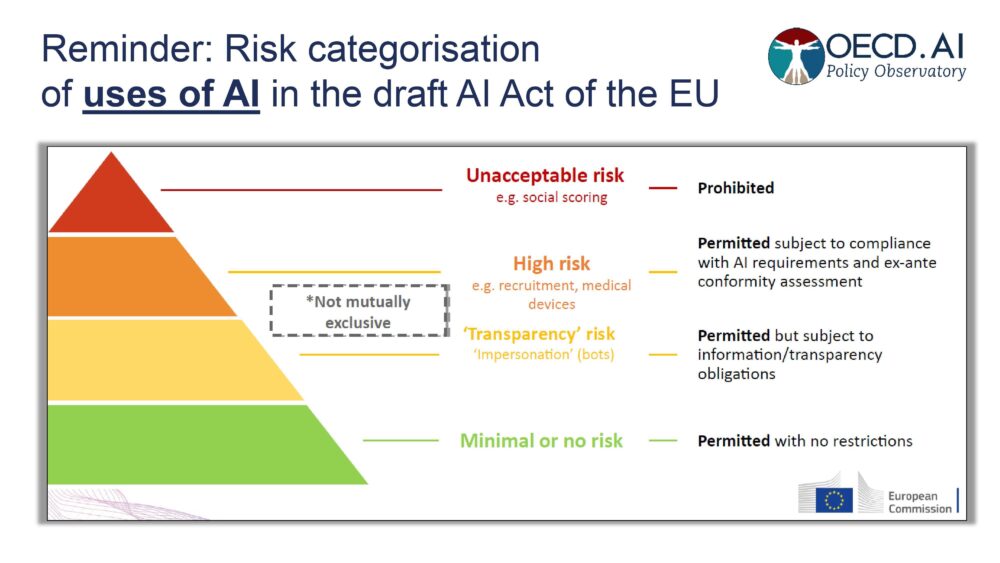

- Ondersteuning van risicobeoordeling: De basis leggen voor verwante werkzaamheden om een risicobeoordelingskader te ontwikkelen dat helpt bij het wegnemen van risico's en het beperken van de gevolgen ervan, en om een gemeenschappelijk kader te ontwikkelen voor de rapportage over AI-incidenten dat de wereldwijde consistentie en interoperabiliteit van de rapportage vergemakkelijkt.

- Ondersteuning van risicobeheer: bijdragen tot de informatieverstrekking over risicobeperking, naleving en handhaving tijdens de levenscyclus van AI-systemen, ook met betrekking tot corporate governance.

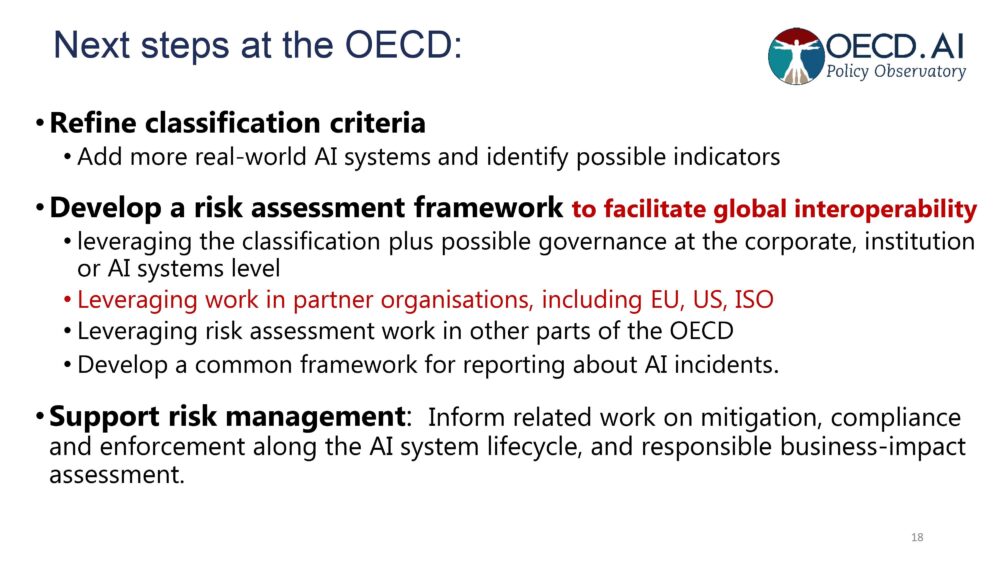

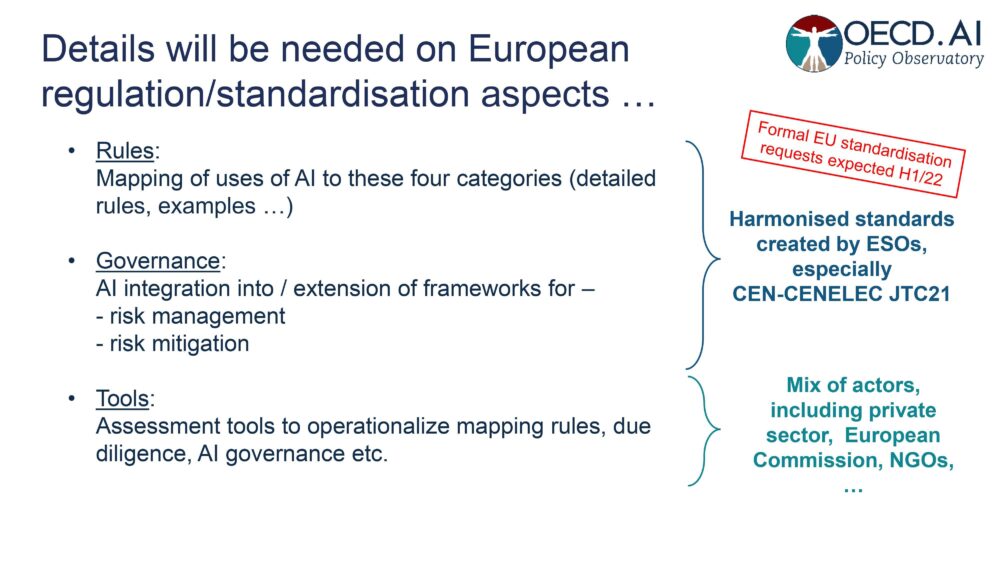

Volgende stappen: volgens de aankondiging van de OESO is het huidige kader bedoeld om de basis te leggen voor de ontwikkeling van een toekomstig risicobeoordelingskader om te helpen bij het verminderen en beperken van risico's. Het zal ook een basis vormen voor de OESO, leden en partnerorganisaties om een gemeenschappelijk kader te ontwikkelen voor de rapportage over AI-incidenten.

Bekijk de OESO-presentatie hieronder: