UK - The roadmap to an effective AI assurance ecosystem

The Center for Data Ethics and Innovation ('CDEI') published a roadmap in December 2021 outlining the steps needed to create a leading ecosystem of tools and services in the United Kingdom ("UK") to build trust in AI. Such an assurance ecosystem for AI services and products enables the actors involved in the development and use of AI to assess the reliability of AI systems and then share this information with others. The step-by-step plan not only establishes the priority areas for action, but also further clarifies the roles and responsibilities of the various actors involved in the ecosystem.

What: policy orienting document

Impactscore: 3 - document with clear policy orientation

For who: organisations in the public sector, policy makers, companies and sectororganisations

URL: https://www.gov.uk/government/publications/the-roadmap-to-an-effective-ai-assurance-ecosystem

Key takeaway for Flanders

The step-by-step plan can be useful for Flanders because it contributes to the creation of an ecosystem in which the reliability of AI is ensured. The plan contains a number of concrete actions that can also be followed in Flanders.

Samenvatting

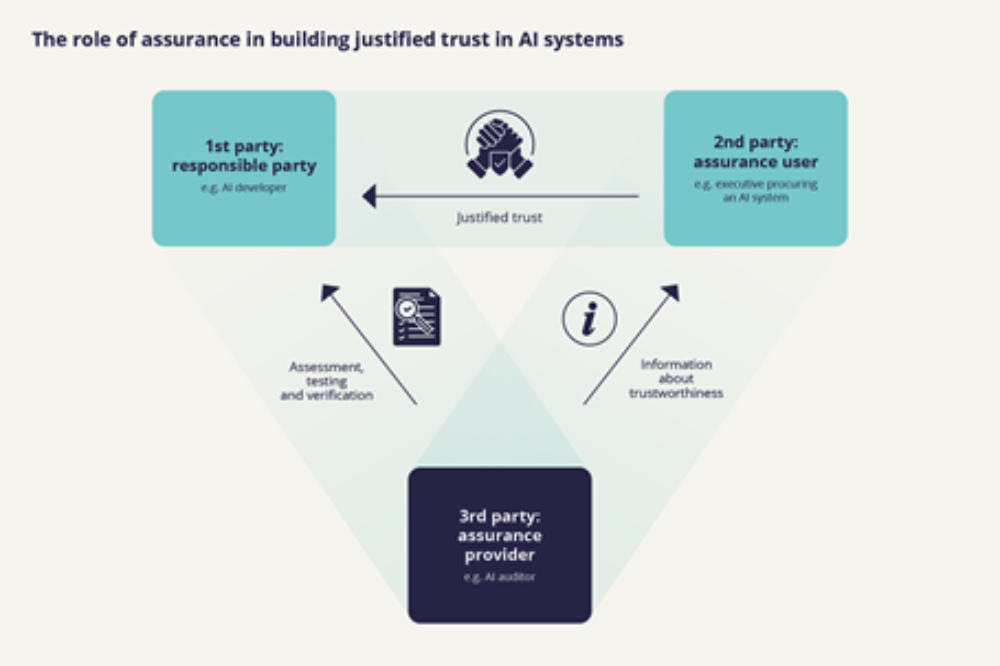

AI biedt vele voordelen en mogelijkheden voor de economie en de samenleving. Deze voordelen zullen echter alleen maar worden gerealiseerd wanneer organisaties, gebruikers en burgers voldoende vertrouwen hebben in AI-systemen en in de manier waarop deze worden ontwikkeld en gebruikt. De Britse regering erkent het belang van dergelijk vertrouwen en heeft in haar nationale AI-strategie de ambitie vooropgesteld om het meest innovatie-bevorderende ecosysteem voor AI-governance ter wereld te worden. Om deze ambitie waar te maken, moeten diverse actoren waaronder beleidsmakers, ontwikkelaars, leidinggevenden en gebruikers begrijpen en communiceren of AI-systemen inderdaad betrouwbaar zijn en of deze aan de toepasselijke regelgeving voldoen. Net zoals in andere sectoren zullen dergelijke assurance-diensten een cruciale rol spelen bij het creëren en in stand houden van vertrouwen in AI-systemen (bv. door middel van audits, gepast communicatie, certificering,...). Onderstaand figuur illustreert dit beter:

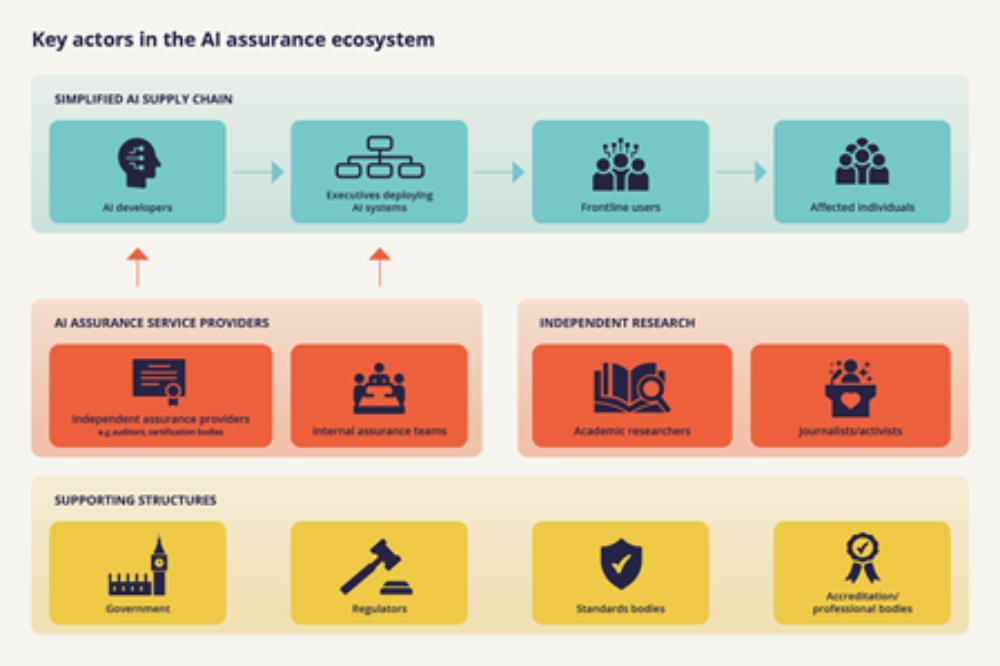

Het CDEI heeft de vereiste stappen bepaald die nodig zijn om een effectief en volwaardig ecosysteem voor de betrouwbaarheid van AI in het VK te ontwikkelen. Een dergelijk assurance ecosystem voor AI-diensten en -producten zal de actoren die betrokken zijn bij de ontwikkeling en het gebruik van AI in staat stellen om de betrouwbaarheid van AI-systemen te beoordelen, en deze informatie vervolgens aan anderen te verstrekken. Het is de eerste keer dat een dergelijk stappenplan werd gepubliceerd. In het plan worden de rollen en verantwoordelijkheden van de verschillende in het ecosysteem betrokken actoren uiteengezet, zoals weergegeven in de volgende figuur:

Daarnaast worden ook zes prioritaire actiegebieden bepaald, namelijk:

- het genereren van de vraag naar betrouwbare en effectieve zekerheid in de hele AI-aanvoerketen;

- het opbouwen van een dynamische concurrerende AI-verzekeringsmarkt die een scala aan effectieve diensten en instrumenten biedt;

- het ontwikkelen van standaarden die voorzien in een gemeenschappelijke taal en schaalbare beoordelingstechnieken voor AI assurance;

- het opbouwen van een verantwoordelijke AI-verzekeringssector;

- het vaststellen van regelgevingsvereisten waaraan kan worden voldaan;

- het verbeteren van de banden tussen de industrie en onafhankelijke onderzoekers zodat onderzoekers kunnen helpen bij de ontwikkeling van assurance-technieken en bij het identificeren van AI-risico's

Om de ontwikkeling van een doeltreffend en volwaardig ecosysteem te ondersteunen, is AI assurance een kernthema van het werkprogramma 2021/22 van het CDEI. Samen met partners uit het bedrijfsleven, regulatoren en de overheid zal het CDEI het komende jaar een aantal stappen zetten om de routekaart (verder) te concretiseren.